推荐4个极速提升编码效率的MCP服务器

是时候通过MCP来提升生产力、最大化您的编码效率了!

随着MCP协议被业界广泛认可,越来越多的MCP服务器被更大平台软件提供方所支持。开发者们是第一批从这些工具中获得效率收益的人,它们能借此重构编码工作流、自动化流程和团队协作机制。

本文将介绍 4 个最近DD有在使用,并且认为对于同为开发者的读者来说非常有用的MCP服务器,下面我会一一介绍并解释其核心特性、应用场景等内容。

是时候通过MCP来提升生产力、最大化您的编码效率了!

随着MCP协议被业界广泛认可,越来越多的MCP服务器被更大平台软件提供方所支持。开发者们是第一批从这些工具中获得效率收益的人,它们能借此重构编码工作流、自动化流程和团队协作机制。

本文将介绍 4 个最近DD有在使用,并且认为对于同为开发者的读者来说非常有用的MCP服务器,下面我会一一介绍并解释其核心特性、应用场景等内容。

朋友们,我最近不是一直在捣鼓小软件嘛!手头这个叫TransDuck的音视频处理工具刚有点小爆的趋势,反馈意见里也是收到不少关于SaaS版本的问题,比如:

近期关于MCP协议的讨论非常热门,主要因为通过MCP协议通过标准化接口为 AI 应用与外部数据源建立统一交互通道,这使得大模型可以与外部数据源或工具进行交互,从而实现各种专业场景下的智能应用。关于如何实现MCP的架构,在上一篇《如何用Spring AI构建MCP Client-Server架构》中已经做了详细介绍。今天我们结合MCP协议聊一下最近另一个更新的协议:A2A(Agent2Agent)协议。

昨天DD以为阿里开源的QwQ-32B会刷爆全网,毕竟对标的是上一个热门项目deepseek-r1。但是,万万没想到,获得更多关注的居然是:Manus。

简单的从网上介绍信息了解了一下,感觉跟OpenAI一月发布Operator智能体有点像(也许很多人还不知道Operator,因为那段时间国内消息几乎被DeepSeek刷屏了,各种逆袭,各种碾压。。。感兴趣的还可以回头翻一翻了解一下),所以DD对Manus的初步认识是算不上炸裂或者颠覆式创新的。由于DD没有Manus的邀请码,没有切身的体会,就不做过多的评论了。如果读者有用过Operator,也用过Manus,欢迎留言区分享一下。

3月6日最新消息,阿里云通义千问官方宣布推出最新推理模型 QwQ-32B,这一模型仅有 32B 参数,但在效果上与拥有 671B 参数的 DeepSeek-R1 相媲美。如果你自己部署 DeepSeek-R1 但资源不够的话,又多了一个新的选择。

QwQ-32B 的独特之处不仅在于其参数规模和效果表现,还集成了与 Agent 相关的能力。这使得模型在使用工具时能够进行批判性思考,并依据环境反馈灵活调整推理过程,极大提升了模型的适应性与智能性。

目前,QwQ-32B 已上线 Hugging Face、ModelScope、Ollama等平台,具体链接如下:

相信大家都已经有体验过deepseek-r1的强大推理能力,由于其网页版本免费使用的原因,用户量激增、同时据传还遭受了大量的网络攻击,这使得过程不是很流程,经常收到类似下图的问题:

同时,API服务也已经暂停充值,之前的余额用完之后暂时也就不用调用了

就在昨晚,Meta发布了可以与OpenAI掰手腕的最新开源大模型:Llama 3.1。

该模型共有三个版本:

对于这次发布,Meta已经在超过150个涵盖广泛语言范围的基准数据集上评估了性能。此外,Meta还进行了广泛的人工评估,在现实场景中将Llama 3.1与竞争模型进行比较。Meta的实验评估表明:

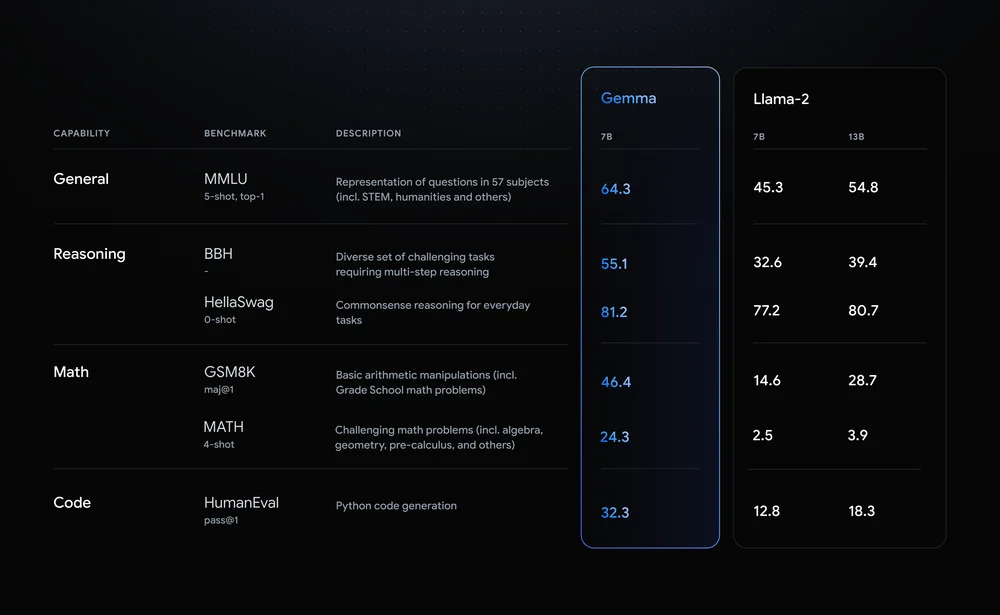

就在昨晚,Google发布了最新的开源大语言模型:Gemma。该模型采用了与Google最强模型Gemini相同的技术基础。

目前开源的Gemma共提供两种规模的模型:2B(20亿参数)和7B(70亿参数)。

该模型的推出主要对标之前主流的开源大模型 Llama-2,从其提供的技术报告来看,Gemma展现了更卓越的性能,Gemma模型甚至可以直接运行在笔记本或台式机上。

而且在重要的基准测试方面,Gemma 7B甚至超越了其他体积更大的模型:

昨天深夜,Googe发布了最新、最强的AI模型:Gemini(双子座),它可以像人一样地实现看、听、说。

真的有这么神么?DD看了一些国内的报道,觉得还不够过瘾。所以,直接去找了一下Google官方介绍,一共有15个视频。